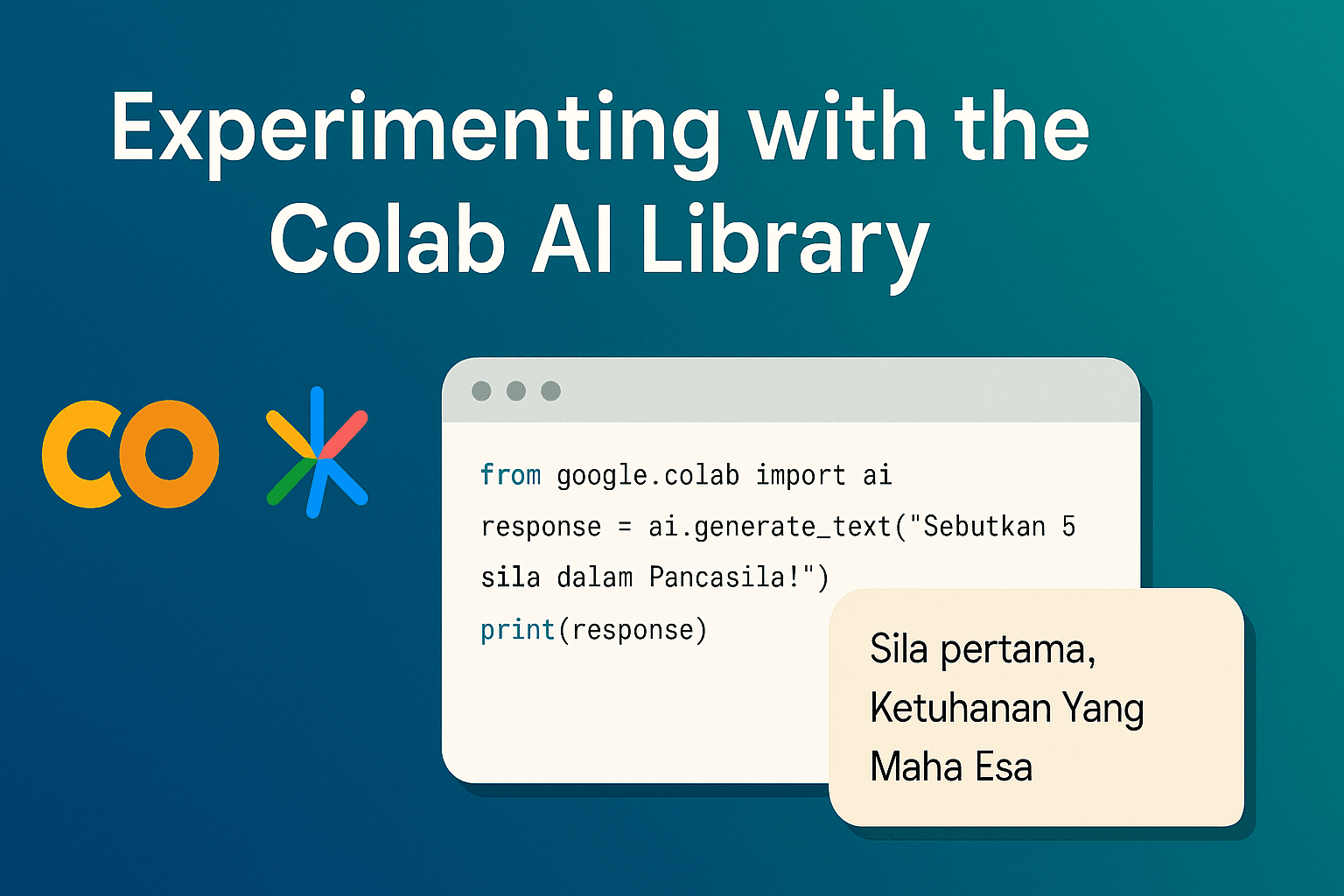

Mencoba google.colab.ai: Akses Gemini Gratis di Google Colab

Lecturer & Researcher at Informatics Engineering. Universitas Komputer Indonesia. Bandung

Bismillah walhamdulillah.

Bagaimana memanfaatkan library google.colab.ai untuk tanya jawab, Text2SQL, NER, analisis sentimen, hingga penilaian jawaban — langsung dari Colab, bahkan untuk pengguna gratis.

Pendahuluan

Model bahasa generatif seperti Gemini dari Google makin mudah diakses. Jika dulu perlu menyiapkan API key, mengatur billing, dan menginstal library tambahan, sekarang Google menyediakan cara yang jauh lebih praktis: cukup buka Google Colab dan gunakan satu baris kode:

from google.colab import ai

Kabar baiknya, fitur ini bisa dinikmati oleh pengguna gratis Colab. Artinya, siapa pun yang punya akun Google bisa mencoba model Gemini tanpa ribet konfigurasi.

Tulisan ini merangkum beberapa eksperimen dengan google.colab.ai di Google Colab, mulai dari:

Melihat daftar model Gemini yang tersedia

Tanya jawab sederhana dan penjelasan konsep

Text2SQL untuk skema database

Named Entity Recognition (NER) berbasis prompt

Question Answering dan generasi soal otomatis

Analisis sentimen (termasuk aspect-based sentiment)

Penilaian jawaban berbasis rubrik

Semua contoh diambil dari satu notebook praktis, dan bisa langsung diadaptasi untuk eksperimen pribadi, pembuatan konten, prototyping produk, maupun riset ringan.

Persiapan Lingkungan di Google Colab

Langkah awalnya sangat sederhana:

Buka Google Colab.

Buat notebook baru (runtime Python standar).

Tambahkan import berikut di salah satu sel kode:

from google.colab import ai

Tidak perlu pip install, tidak perlu API key. Selama menggunakan build Colab yang sudah mendukung google.colab.ai, kode ini akan langsung berjalan dan siap memanggil model Gemini di belakang layar.

Fungsi Dasar google.colab.ai

Bagian ini merangkum beberapa fungsi dasar yang digunakan di notebook: ai.list_models() dan ai.generate_text().

1. Melihat daftar model Gemini yang tersedia

Sebelum mulai, ada baiknya melihat dulu model apa saja yang bisa dipakai. Di notebook, hal ini dilakukan dengan kode:

from google.colab import ai

ai.list_models()

Perintah ini menampilkan daftar model seperti gemini-2.5-flash, gemini-2.5-flash-lite, dan lain-lain. Dari sini bisa dipilih:

Model yang ringan dan cepat untuk eksperimen.

Model yang lebih besar untuk kualitas jawaban yang lebih baik.

Daftar model ini juga membantu jika ingin mengunci eksperimen ke satu model tertentu demi konsistensi hasil.

2. Tanya jawab sederhana dengan ai.generate_text

Contoh paling dasar adalah tanya jawab. Di notebook, digunakan kode berikut:

from google.colab import ai

respons = ai.generate_text("Sebutkan 5 sila dalam Pancasila!")

print(respons)

Dengan satu prompt singkat, model mengembalikan jawaban lengkap. Pola ini bisa digunakan untuk banyak hal:

Meminta penjelasan konsep tertentu.

Menghasilkan contoh-contoh tambahan.

Membuat ringkasan atau penjelasan singkat.

Cara termudah bereksperimen adalah dengan mengubah teks prompt dan mengamati bagaimana respons model berubah.

3. Memilih model tertentu: google/gemini-2.5-flash-lite

Terkadang perlu mengontrol model yang digunakan, misalnya demi kecepatan respons. Di notebook, hal ini dilakukan dengan menambahkan parameter model_name:

from google.colab import ai

respons = ai.generate_text(

"Sebutkan rukum iman dalam agama Islam!",

model_name="google/gemini-2.5-flash-lite"

)

print(respons)

Model flash-lite biasanya lebih hemat sumber daya dan cukup untuk tugas-tugas ringan seperti tanya jawab singkat. Untuk tugas yang membutuhkan penalaran lebih dalam, bisa mencoba model lain yang tersedia di hasil ai.list_models().

4. Menampilkan jawaban secara streaming

Untuk jawaban yang lebih panjang, google.colab.ai mendukung mode streaming sehingga teks muncul sedikit demi sedikit seperti sedang diketik. Contoh di notebook:

from google.colab import ai

stream = ai.generate_text(

"Jelaskan secara singkat tentang Large Language Models",

stream=True

)

for teks in stream:

print(teks)

Mode ini terasa lebih interaktif, terutama saat mendemonstrasikan konsep atau ketika ingin melihat proses terbentuknya jawaban secara bertahap, bukan langsung satu blok teks panjang.

Use Case 1 – Text2SQL untuk Skema Database Sederhana

Bagian berikut memperlihatkan bagaimana google.colab.ai dapat menghubungkan bahasa alami dengan SQL. Ini sangat berguna untuk eksperimen dengan basis data.

Di notebook, didefinisikan skema database sederhana bernama hobimahasiswa dengan tabel mahasiswa, hobi, dan mhshobi. Lalu dibuat fungsi text2sql(question) yang menerima pertanyaan dalam bahasa Indonesia dan mengembalikannya sebagai query SQL.

from google.colab import ai

schema = """

Database: hobimahasiswa

Tabel: mahasiswa

- nim (PRIMARY KEY)

- nama

Tabel: hobi

- kode_hobi (PRIMARY KEY)

- nama_hobi

Tabel: mhshobi

- nim (FOREIGN KEY ke mahasiswa.nim)

- kode_hobi (FOREIGN KEY ke hobi.kode_hobi)

"""

def text2sql(question):

prompt = f"""

Kamu adalah asisten pembuat SQL.

Gunakan skema berikut:

{schema}

Tugas:

- Terjemahkan pertanyaan berikut menjadi SQL query valid.

- Jangan berikan penjelasan, hanya SQL saja.

Pertanyaan:

{question}

"""

sql = ai.generate_text(prompt)

return sql

print(text2sql("Tampilkan nama mahasiswa yang memiliki hobi Memasak."))

Prompt memberikan konteks berupa skema database serta instruksi yang tegas: model hanya boleh mengembalikan SQL, tanpa penjelasan tambahan. Hasilnya adalah query SQL yang secara umum sudah cukup baik untuk dijalankan di sistem basis data (tetap disarankan untuk meninjau ulang sebelum digunakan di sistem produksi).

Use Case 2 – Named Entity Recognition (NER) dengan Prompt

Untuk teks panjang, kadang perlu mengekstrak entitas penting seperti nama orang, organisasi, lokasi, atau tanggal. Di sini google.colab.ai digunakan sebagai “NER on demand” tanpa perlu melatih model khusus.

Contoh di notebook menggunakan paragraf tentang seminar kecerdasan buatan di UNIKOM:

from google.colab import ai

paragraph = """

Pada tanggal 15 Januari 2023, Universitas Komputer Indonesia (UNIKOM) di Bandung

mengadakan seminar mengenai pemanfaatan kecerdasan buatan. Seminar tersebut

dihadiri oleh para dosen seperti Galih Hermawan serta beberapa perwakilan

dari Kementerian Pendidikan dan Kebudayaan. Acara ini juga bekerja sama dengan

Google Indonesia.

"""

prompt = f"""

Lakukan Named Entity Recognition (NER) pada paragraf berikut.

Tampilkan hasil dalam format JSON dengan struktur:

- person

- organization

- location

- date

Paragraf:

{paragraph}

"""

response = ai.generate_text(prompt)

print(response)

Model akan mencoba mengembalikan daftar entitas, misalnya:

person: daftar nama orang

organization: nama organisasi yang muncul

location: lokasi acara

date: tanggal kegiatan

Hasil ini bisa digunakan untuk analisis teks lebih lanjut, pembuatan ringkasan, atau sekadar eksplorasi data teks berbahasa Indonesia.

Use Case 3 – Question Answering dan Generasi Soal Otomatis

Bagian berikut berfokus pada Question Answering (QA) dan pembuatan soal otomatis dari teks konteks.

3.1 QA berdasarkan paragraf konteks

Pertama, disiapkan paragraf tentang sejarah Google, lalu diajukan pertanyaan yang jawabannya ada di dalam paragraf tersebut:

from google.colab import ai

context = """

Google didirikan pada tahun 1998 oleh Larry Page dan Sergey Brin ketika keduanya

masih menjadi mahasiswa PhD di Stanford University. Perusahaan ini berkembang

pesat seiring dengan popularitas mesin pencariannya. Saat ini, Google menjadi

bagian dari Alphabet Inc. dan berfokus pada berbagai bidang seperti kecerdasan

buatan, komputasi awan, perangkat keras, dan layanan digital.

"""

question = "Kapan Google didirikan dan siapa pendirinya?"

prompt = f"""

Jawab pertanyaan berikut berdasarkan konteks yang diberikan.

Konteks:

{context}

Pertanyaan:

{question}

Berikan jawaban yang singkat dan langsung ke inti.

"""

response = ai.generate_text(prompt)

print(response)

Model diminta secara eksplisit untuk menjawab berdasarkan konteks yang diberikan. Pola ini mirip dengan tugas reading comprehension di berbagai aplikasi QA berbasis dokumen.

3.2 Membuat pertanyaan dan jawaban otomatis dari paragraf

Selanjutnya, model diminta menyusun soal sendiri dari sebuah paragraf. Contoh di notebook menggunakan konteks tentang UNIKOM:

from google.colab import ai

context = """

UNIKOM (Universitas Komputer Indonesia) adalah salah satu perguruan tinggi

swasta terkemuka di Bandung yang berfokus pada teknologi informasi, desain,

dan bisnis. Kampus ini didirikan pada tahun 2000 dan terus berkembang sebagai

pusat pendidikan inovatif di bidang informatika.

"""

prompt = f"""

Buat satu pertanyaan dan jawabannya berdasarkan paragraf berikut.

Konteks:

{context}

Format output:

Q: <pertanyaan>

A: <jawaban>

"""

response = ai.generate_text(prompt)

print(response)

Ada pula variasi lain yang menghasilkan lima pasang pertanyaan dan jawaban dengan format bernomor, serta versi yang menghasilkan output JSON dengan struktur:

[

{"question": "...", "answer": "..."},

{"question": "...", "answer": "..."},

{"question": "...", "answer": "..."}

]

Teknik seperti ini berguna untuk membuat bank soal, kuis, atau daftar pertanyaan wawancara dari satu paragraf sumber tanpa menulis semuanya secara manual. Berikut contoh kode dan luaran yang menghasilkan pertanyaan dan jawaban yang dibuat oleh model berdasarkan konteks berbeda dengan sebelumnya, yaitu tentang sejarah perjuangan bangsa Indonesia.

context = """

Selama lebih dari tiga setengah abad, bangsa Indonesia ...

"""

prompt = f"""

Buatkan 3 pertanyaan dan jawabannya berdasarkan paragraf berikut.

Hasilkan dalam format JSON seperti:

[

{{"question": "...", "answer": "..."}},

{{"question": "...", "answer": "..."}},

{{"question": "...", "answer": "..."}}

]

Paragraf:

{context}

"""

print(ai.generate_text(prompt))

Use Case 4 – Analisis Sentimen

Notebook juga memuat dua jenis analisis sentimen: sentimen per kalimat dan sentimen berbasis aspek (Aspect-Based Sentiment Analysis / ABSA).

4.1 Analisis sentimen kalimat per kalimat

Contoh pertama menggunakan beberapa kalimat ulasan dalam bahasa Indonesia. Model diminta mengklasifikasikan sentimen setiap kalimat sebagai “positif”, “netral”, atau “negatif” dan mengembalikan hasilnya dalam format JSON:

from google.colab import ai

texts = [

"Pelayanan di restoran ini sangat ramah dan makanannya enak sekali!",

"Pengiriman barangnya terlambat dua hari dan tanpa konfirmasi. Mengecewakan.",

"Aplikasinya cukup bagus, tapi kadang masih ada bug yang mengganggu.",

"Saya sangat puas dengan kualitas produk ini. Recommended!",

"Tempatnya sulit dicari, tapi suasananya nyaman."

]

prompt = f"""

Lakukan analisis sentimen pada daftar kalimat berikut.

Kelas sentimen: "positif", "netral", atau "negatif".

Berikan hasil dalam format JSON list seperti:

[

{{"text": "...", "sentiment": "..."}},

...

]

Daftar kalimat:

{texts}

"""

response = ai.generate_text(prompt)

print(response)

Output JSON ini dapat diproses lebih lanjut, misalnya diubah menjadi DataFrame untuk visualisasi atau analisis statistik sederhana terhadap opini pengguna.

4.2 Aspect-Based Sentiment Analysis (ABSA)

Contoh berikutnya melangkah lebih jauh dengan melakukan analisis sentimen berbasis aspek. Setiap ulasan bisa memuat beberapa aspek sekaligus (makanan, pelayanan, harga, tampilan aplikasi, performa, lokasi, dll.). Model diminta untuk:

Menemukan aspek-aspek penting dalam tiap ulasan.

Menentukan sentimen untuk tiap aspek.

Mengembalikan hasil dalam format JSON.

from google.colab import ai

reviews = [

"Makanannya enak tapi pelayanannya lambat, dan harganya agak mahal.",

"Aplikasi ini tampilannya bagus dan mudah dipakai, tapi sering crash.",

"Hotel nyaman dan lokasinya strategis, tapi kebersihannya kurang.",

"Kualitas produk sangat baik, pengemasan rapi, dan harga cukup terjangkau.",

"Tempatnya luas dan parkirnya gampang, tapi antriannya panjang sekali."

]

prompt = f"""

Lakukan Analisis Sentimen Multi-Aspek (Aspect-Based Sentiment Analysis)

pada daftar ulasan berikut.

Instruksi:

1. Temukan aspek-aspek penting dalam tiap ulasan (misalnya: makanan, pelayanan,

harga, kualitas, kebersihan, tampilan aplikasi, performa, lokasi, dll.)

2. Tentukan sentimen untuk tiap aspek: "positif", "netral", atau "negatif".

3. Keluarkan hasil dalam format JSON list, struktur:

[

{{

"text": "...",

"aspects": [

{{"aspect": "...", "sentiment": "..."}},

...

]

}},

...

]

Daftar ulasan:

{reviews}

"""

response = ai.generate_text(prompt)

print(response)

Pendekatan ini cukup dekat dengan kebutuhan dunia nyata, misalnya untuk menganalisis ulasan restoran, hotel, aplikasi, atau produk. Hasilnya bisa dipakai untuk melihat aspek mana yang paling sering dipuji atau dikritik.

Use Case 5 – Penilaian Jawaban dengan Gemini

Bagian terakhir notebook memperlihatkan bagaimana google.colab.ai dapat membantu menilai jawaban berbentuk teks. Di sini model diposisikan sebagai evaluator yang memberikan penilaian awal dan komentar, sementara keputusan akhir tetap berada di tangan pengguna.

5.1 Penilaian multi-soal dan multi-jawaban

Di notebook, disiapkan beberapa soal tentang machine learning beserta jawaban dari beberapa orang. Prompt kemudian meminta model untuk:

Menilai setiap jawaban berdasarkan ketepatan konsep, kejelasan, dan relevansi.

Memberikan skor 0–100 untuk setiap soal.

Menulis komentar singkat per soal.

Menghasilkan ringkasan nilai akhir dalam format JSON.

Dengan cara ini, AI dapat membantu memberi gambaran awal kualitas jawaban. Output-nya bisa dipakai untuk diskusi, review, atau sekadar bahan refleksi pribadi bagi penjawab.

5.2 Penilaian dengan rubrik terstruktur (3 aspek)

Versi lanjutan di notebook menggunakan rubrik yang lebih jelas: Ketepatan Konsep, Kejelasan Penjelasan, dan Relevansi. Model diminta untuk:

Memberikan nilai 0–100 untuk setiap aspek.

Menghitung skor per soal sebagai rata-rata dari tiga aspek.

Menghitung skor total sebagai rata-rata seluruh soal.

Menyertakan komentar singkat untuk setiap jawaban.

Luarannya berupa JSON yang cukup informatif, sehingga mudah dibaca maupun diproses lebih lanjut (misalnya untuk membuat laporan atau visualisasi). Pendekatan ini menunjukkan bagaimana AI dapat membantu menerapkan rubrik penilaian dengan cara yang konsisten dan terstruktur.

Tips Praktis Menggunakan google.colab.ai

Beberapa tips praktis saat bereksperimen dengan google.colab.ai di Google Colab:

Mulai dari contoh yang dekat dengan konteks sehari-hari. Misalnya Pancasila, sejarah Indonesia, atau kasus di sekitar lingkungan sendiri.

Eksperimen dengan berbagai prompt. Ubah instruksi, gaya bahasa, atau format luaran, lalu lihat bagaimana hasilnya berubah.

Selalu lakukan pengecekan kritis. Luaran model bisa keliru, bias, atau terlalu percaya diri. Anggap sebagai asisten yang membantu, bukan sumber kebenaran mutlak.

Manfaatkan format terstruktur. Saat memungkinkan, minta luaran dalam bentuk terstruktur, misal JSON, agar mudah diolah lebih lanjut di Python atau aplikasi lain.

Kesimpulan

Library google.colab.ai membuka peluang besar untuk memanfaatkan model Gemini langsung dari Google Colab, bahkan bagi pengguna gratis. Dengan satu baris import, berbagai skenario dapat dicoba, antara lain:

Tanya jawab dan penjelasan konsep

Konversi bahasa alami ke SQL (Text2SQL)

Named Entity Recognition dan Question Answering berbasis konteks

Analisis sentimen dan aspect-based sentiment

Penilaian jawaban teks dengan rubrik terstruktur

Notebook contoh yang menjadi dasar tulisan ini dapat dikembangkan menjadi berbagai eksperimen lain: integrasi dengan aplikasi web, analisis data teks, pembuatan konten otomatis, dan banyak lagi. Dengan pendekatan ini, AI bukan hanya topik yang dibicarakan, tetapi juga alat praktis yang membantu menyelesaikan pekerjaan sehari-hari.

Fail notebook dapat diakses dan dijalankan di tautan berikut:

https://colab.research.google.com/drive/1qA-b1gRhVereJAmWbOmKlHrPqytLg9ND?usp=sharing

Repository: